¿Recibís mucho spam? Cómo la IA está superando fácilmente los captchas de Google

Charly Cerebrito

Charly Cerebrito

Durante años, los captchas fueron una de las principales defensas de internet contra el spam, los bots y las actividades automatizadas.

Ese pequeño test que nos pedía “marcar todos los semáforos” o “escribir las letras distorsionadas” se convirtió en una prueba cotidiana para demostrar que somos humanos.

Sin embargo, hoy en día la realidad es otra: los bots impulsados por inteligencia artificial pueden resolver esos mismos desafíos con una precisión y velocidad que supera, incluso, a la del usuario promedio.

La evolución del captcha: del texto al comportamiento

Google, a través de su sistema reCAPTCHA, intentó mantenerse un paso adelante. Su versión más moderna, reCAPTCHA v3, ya ni siquiera muestra imágenes: analiza el comportamiento del usuario (movimientos del mouse, velocidad de escritura, patrones de clics) para determinar si se trata de una persona o una máquina.

El problema es que las máquinas ahora pueden comportarse como personas. Los modelos de IA actuales aprenden patrones humanos, imitan sus movimientos y logran burlar con facilidad estos filtros que antes parecían infranqueables.

Cuando la solución se convierte en problema

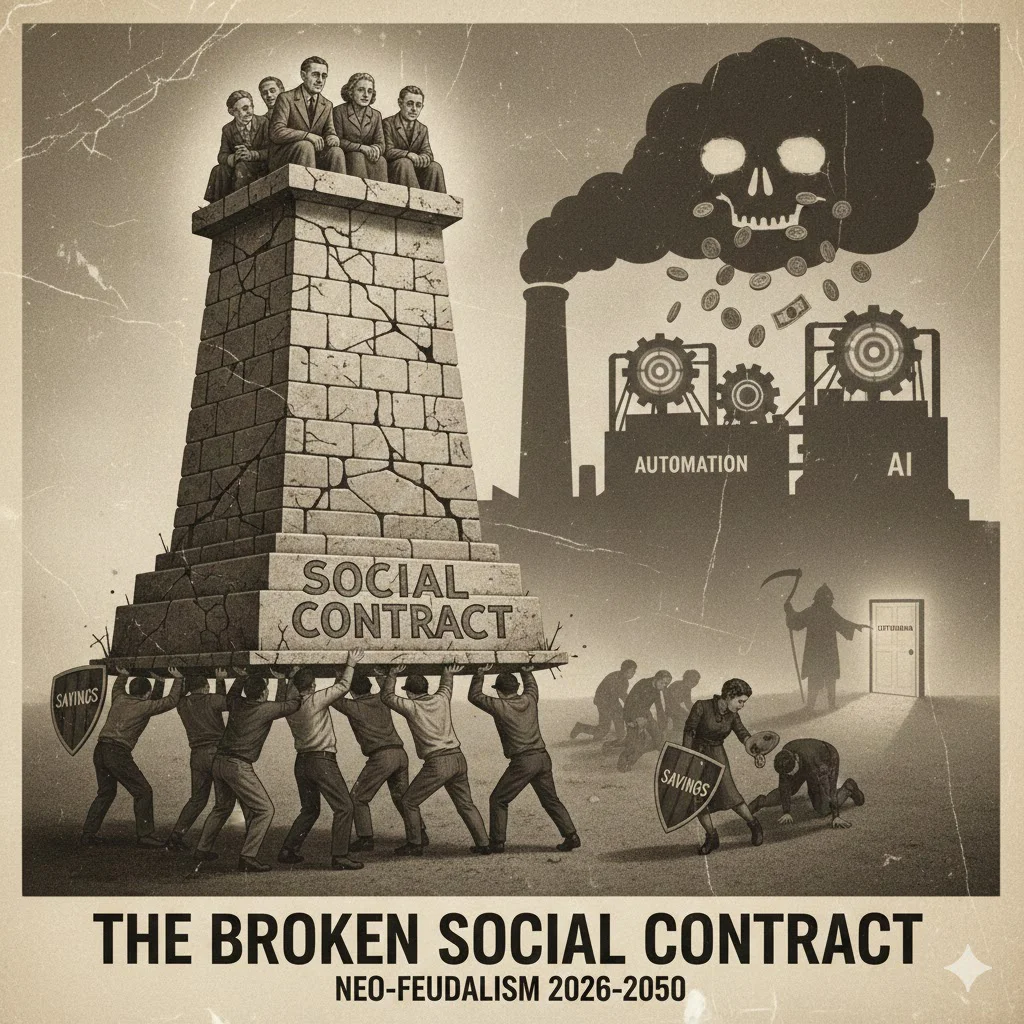

La paradoja es clara: cuanto más inteligente es la IA, más difícil se vuelve distinguir entre un usuario real y un bot.

Los sistemas automáticos que antes servían para proteger a las plataformas hoy pueden ser explotados por programas que utilizan IA generativa, visión artificial o aprendizaje por refuerzo para superar cualquier prueba.

Y eso tiene un efecto directo en nuestra vida digital cotidiana: más spam, más mensajes fraudulentos, más formularios saturados y más cuentas falsas inundando las redes.

¿Y si volvemos a los sistemas antiguos?

Una posible opción para franquear este problema podría ser volver a versiones anteriores de captcha, basadas en rompecabezas, imágenes o pequeños desafíos lógicos.

Por ejemplo, arrastrar piezas para completar una figura o responder una pregunta simple.

Estos métodos apelan a la percepción y al razonamiento humano, lo que, al menos por ahora, sigue siendo un límite para muchas inteligencias artificiales. Pero la gran pregunta es: ¿hasta cuándo funcionará esto?

La frontera entre lo humano y lo artificial se vuelve cada vez más difusa. Los modelos de IA que hoy pueden generar arte, escribir código o analizar imágenes complejas pronto también podrán resolver cualquier captcha visual o lógico que se les presente.

IA: una herramienta ambivalente

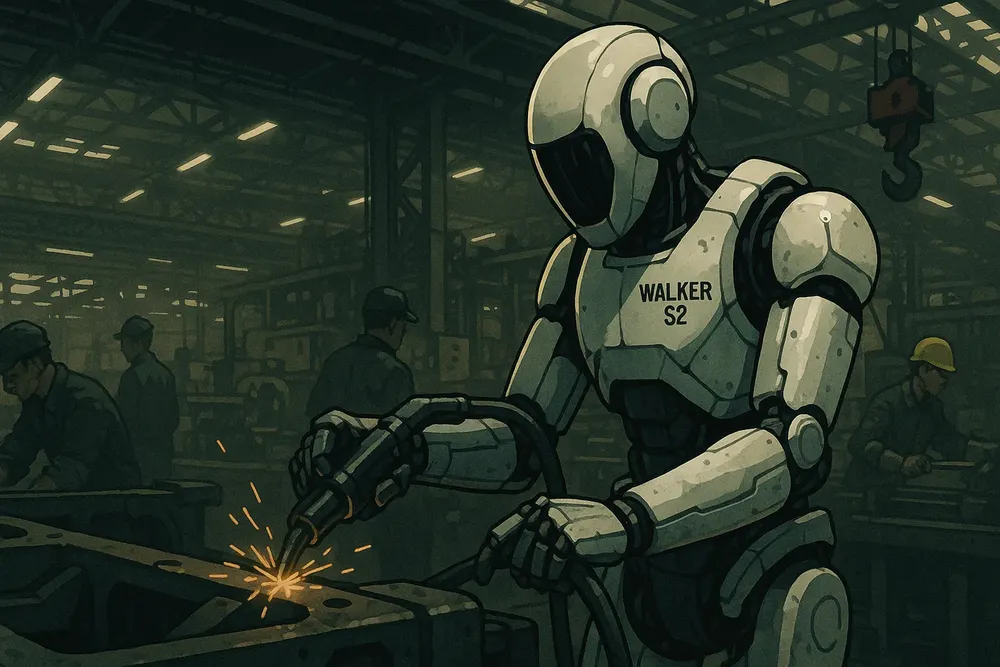

La inteligencia artificial está transformando el mundo, ayudando a científicos, médicos, programadores y creadores a resolver problemas con una velocidad sin precedentes.

Pero el mismo poder que permite detectar enfermedades o traducir idiomas al instante también puede ser utilizado para automatizar el fraude, difundir spam o vulnerar sistemas de seguridad.

La IA no distingue el bien del mal: solo ejecuta. Todo depende de quién la programe y con qué intención.

El futuro de la verificación humana

Mientras la tecnología avanza, la gran incógnita sigue abierta: ¿cómo podremos distinguir a los humanos de las máquinas en los próximos años?

Probablemente, las plataformas deban combinar distintos métodos de autenticación, desde biometría hasta análisis contextual, para mantener a raya a los bots.

Lo cierto es que la línea se sigue borrando, y el desafío ya no es sólo técnico, sino ético.

Porque al final del día, lo que está en juego no es si resolvemos un captcha, sino si seguiremos siendo los humanos quienes controlen la conversación digital.

“Cuando tus datos de uso se filtran sin que lo sepas”: así fue el incidente Mixpanel – OpenAI

Caída global de Cloudflare: una falla interna provocó interrupciones masivas el 18 de noviembre de 2025

Gemini llega a Android Auto: La conducción inteligente redefinida por Google

Bots con inteligencia artificial: la nueva amenaza para los formularios públicos en la web

Claves para comprender los móviles de Xiaomi: desde el 12 al 15 Ultra

¿Cuáles son las mejores plataformas para gestionar un periódico digital?